上海财经大学联合财跃星辰正式发布开源首个金融领域R1类推理大模型Fin-R1:以7B轻量化参数规模逼近DeepSeek-R1的671B满血版性能

发布时间:2025-03-21 浏览次数:65

近日,上海财经大学统计与数据科学学院教授张立文与其领衔的金融大语言模型课题组(SUFE-AIFLM-Lab)联合财跃星辰、数据科学和统计研究院、滴水湖高级金融学院正式发布首款DeepSeek-R1类推理型人工智能金融大模型:Fin-R1,以仅7B的轻量化参数规模展现出卓越性能,全面超越参评的同规模模型并以75.2的平均得分位居第二,与参数量为671B的行业标杆DeepSeek-R1平均分差距仅3.0分。Fin-R1基于Qwen2.5-7B-Instruct模型开发,通过构建高质量金融推理数据集与两阶段混合框架训练,实现了金融推理的逻辑闭环,其技术创新表明高校在垂直领域大模型研发中实现了从技术突破到产业落地的闭环,标志着高校在金融科技领域的自主创新迈入新高度。

Github地址:https://github.com/SUFE-AIFLM-Lab/Fin-R1

技术报告:https://arxiv.org/abs/2503.16252

模型地址:https://huggingface.co/SUFE-AIFLM-Lab/Fin-R1

1、简介

当前推理型大语言模型在众多领域正迅速发展,然而当通用推理模型落地金融领域时,仍面临垂直场景适配性不足的挑战。金融推理任务常涉及法律条款、经济指标、数理建模等知识,不仅需要跨学科知识融合,更要求可验证的、分步骤的决策逻辑。在实际的金融业务场景中,模型应用普遍面临知识整合困难、决策过程不透明、业务泛化能力不足等问题。

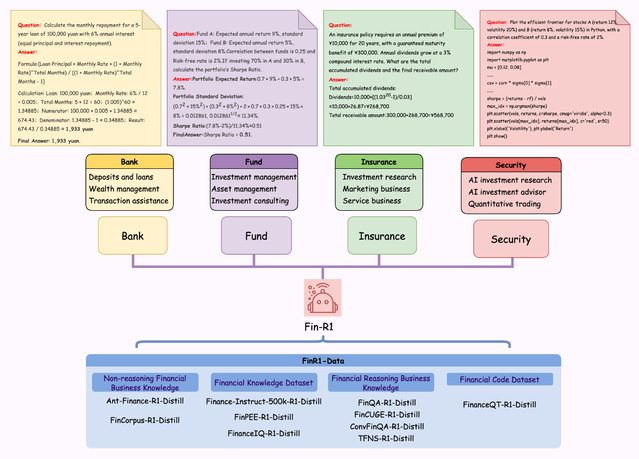

为此,我们从多个权威数据源蒸馏并筛选出约 60k 条面向金融专业场景的高质量COT数据集 Fin-R1-Data,该数据集涵盖中英文金融垂直领域的多维度专业知识并根据具体任务内容将其分为金融代码、金融专业知识、金融非推理类业务知识和金融推理类业务知识四大模块,可有效支撑银行、证券以及信托等多个金融核心业务场景。在Fin-R1-Data数据的基础上我们以Qwen2.5-7B-Instruct为基座进行指令微调 (SFT) 预热和强化学习 (RL) 训练得到金融推理大模型 Fin-R1。我们通过构建金融高质量CoT数据集与结合指令微调(SFT)和强化学习(RL)进行训练的两阶段工作框架为模型在金融领域的应用提供了坚实的理论支撑、决策逻辑以及技术实现能力,同时能有效提升模型的金融复杂推理能力和泛化能力,使模型在金融推理任务中展现出卓越性能。

图1 Fin-R1应用场景示例

Fin-R1的总体工作流程如下:我们首先通过构建60k规模的金融推理数据集Fin-R1-Data,帮助模型重构知识体系,然后采用"两步骤训练框架"塑造模型认知和推理能力,最后在多个金融基准测试上验证模型的性能突破,实现了从“数据构建-模型训练-性能验证-模型部署-场景应用”的完整技术闭环。

图2 Fin-R1总体工作流程

2、场景应用——强大的多场景适配能力

金融代码:

金融计算:

英文金融计算:

金融安全:

智能风控:

ESG分析:

3、数据构建——破解知识碎片难题

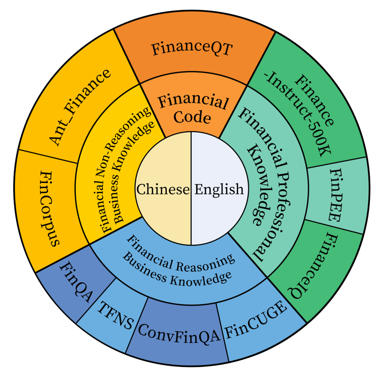

传统的金融数据分散、标注成本高,而且缺乏对复杂推理逻辑的针对性设计,导致模型难以适配金融业务场景,为将 DeepSeek-R1 的推理能力迁移至金融场景并解决高质量金融推理数据问题,我们用Deepseek - R1(满血版)针对涵盖行业语料(FinCorpus、Ant_Finance),专业认知(FinPEE),业务知识(FinCUGE、FinanceIQ、Finance-Instruct-500K),表格解析(FinQA),市场洞察(TFNS),多轮交互(ConvFinQA)以及量化投资(FinanceQT)的多个数据集进行领域知识蒸馏筛选,构建了约 60k 条面向专业金融推理场景的高质量 COT 数据集 Fin-R1-Data 。

图3 Fin-R1数据生成流程

3.1数据蒸馏

在蒸馏过程中,我们构建了基于 Deepseek - R1 的数据蒸馏框架。在蒸馏过程中,严格遵循 DeepSeek - R1 官方规范配置参数,具体参数配置如下:

l将 temperature 设定为 0.6;

l针对数学类型数据,采用" 请用\\boxed{{}}格式包裹最终答案 "作为标准化提示词;

l防止跳出思维模式,强制在每个输出的开头增加"\n",再开始生成数据。

3.2数据筛选

为了保证数据质量,项目组首创“答案+推理逻辑”双轮打分机制,双轮质检,严把数据关。

l第一轮:用规则匹配和Qwen2.5-72B-Instruct对答案准确性进行打分,确保数据“零错误”;

l第二轮:深度校验推理逻辑的一致性和术语合规性,让AI的“思维链条”严丝合缝。

l第三轮:引入金融专家团队对关键数据进行人工复核,保障训练数据高质量。

图4 Fin-R1数据分布

表1 Fin-R1数据量表

4、模型训练——“划重点-考试-打分”模式给AI上"金融特训课",两步打造金融决策专家

4.1 特训成果:金融界的"最强大脑"

针对金融领域复杂推理任务,我们利用 Qwen2.5-7B-Instruct 进行两步骤微调训练得到金融推理大语言模型 Fin-R1 。首先通过高质量金融推理数据的 SFT (Supervised Fine-Tuning) 帮助模型重构知识体系,然后在 GRPO(Group Relative Policy Optimization) 算法的基础上结合格式奖励和准确度奖励进行强化学习,以此提升金融推理任务的准确性和泛化能力。Fin-R1能够完整地呈现思考过程,为金融决策提供深入且有价值的洞察,更为金融投资、风险管理、智能投顾以及量化交易等金融业务领域提供了可靠的技术底座。未来,这样的"金融特训营"模式有望在更多专业领域复制推广。

4.2 微调训练(SFT指令微调)

针对非推理类模型在RL训练过程中存在训练不稳定等问题,研究团队对AI进行专项知识补课,像教学生一样训练模型,让非推理类模型掌握金融推理的基本功。使用金融推理数据集对模型进行定向训练(SFT),使模型初步具备长思维链思考模式,降低模型训练难度,保证训练稳定性。

4.3 实战优化(RL强化学习)

通过考试和专家打分(RL强化学习),不断纠正AI在复杂场景中的判断失误,确保每个决策都经得起推敲。在模型掌握基础知识后,通过"考试+专家打分"机制(RL)持续提升专业性:

l智能考官把关:引入Qwen2.5-Max作为验证器用于检查答案对错,比传统正则表达式方式准确度更高。

l双轨打分制:采用“基于规则的格式奖励 “和”基于模型验证的准确性奖励 “两种奖励训练模型,实现金融文本生成“形神兼备”。

图5 Fin-R1模型训练流程

5、性能验证——专业场景性能超越,验证技术闭环价值

在覆盖多项金融业务场景的权威评测中,我们考虑模型的推理能力与资源消耗,将Fin-R1与涵盖轻量级和高性能的不同模型进行了全面评估。最终Fin-R1以仅7B的轻量化参数规模展现出显著的性能优势,以75.2的平均得分位居第二,全面超越同规模参评模型,同时与行业标杆 DeepSeek-R1 平均分差距仅3.0分,且超越DeepSeek-R1-Distill-Llama-70B(69.2)6.0分。此外,Fin-R1在聚焦真实金融表格数值推理任务的FinQA 以及多轮交互场景的ConvFinQA 两大关键任务测试上分别以76.0和85.0的得分在参评模型中登顶第一,展现出了模型在金融推理场景及金融多轮交互场景中的强大处理能力。

Fin-R1的评测表现不仅反映出模型在投顾服务、投资者会议等多轮交互场景中具有长对话跟踪能力,能避免传统模型常见的上下文遗忘或逻辑跳跃问题并生成逻辑连贯的渐进式建议,同时展现出模型在处理财务报表重组、财务比率交叉验证时的强大数值推理能力。精准覆盖金融行业对可解释性、合规性、数值严谨性的核心诉求。具体评测结果如下:

表2Fin-R1及其他模型在各数据集上的评测表现

6、模型部署

Github现已提供"开箱即用"的本地化部署方案,只需运行一个安装脚本,就能在单张4090显卡上轻松部署Fin-R1模型。无论是银行风控还是量化交易,用户都能快速上手,解决各类金融场景问题,真正实现"一键部署,金融AI触手可及"!

7、场景应用

Fin-R1在金融领域展现出多场景适配能力:它能轻松搞定交易系统代码生成、DCF估值、期权定价等复杂计算任务,还支持英文金融计算,助力跨境业务分析。在金融安全与合规方面,Fin-R1化身“风控卫士”实时监测交易异常;在智能风控领域,它的动态信用评分模型让风险评估更精准。同时,Fin-R1还能协助生成符合GRI标准的ESG报告,助力企业绿色转型。这些场景应用均可在GitHub中查看。

8、总结

Fin-R1从训练框架到模型权重均开源,计算资源需求量小,个人电脑即可部署,更加适用于金融场景,并且通过两阶段训练框架,解决了金融数据碎片化和推理逻辑不可控等问题,在各大金融基准测试中表现卓越,展现出强大的推理能力和业务泛化能力,为金融智能化发展提供了有力支持。